🥑 Coursera의 "Neural Networks and Deep Learning" 강좌의 내용을 배우면서 개인적으로 정리한 내용입니다.

경사 하강법(Gradient Descent)은 비용 함수(Cost Function)의 최소값을 구하는 알고리즘이다. 이 알고리즘은 실제로 머신러닝에서 모든곳에서 사용중이다.

경사 하강법을 진행하는 과정

1. θ에 대해 임의의 초기값(시작점)을 잡는다.

2. J가 최소가 될 때 까지 θ값 갱신을 반복하여 최솟값에 도달했을 때의 θ를 찾는다.

미분 값에 대해

경사하강법에서 미분 값은 비용 함수의 기울기를 나타낸다.

비용 함수의 기울기는 현재 파라미터에서 비용 함수의 변화율을 나타내며, 경사의 방향과 크기를 결정한다.

기울기를 사용하여 경사하강법은 비용 함수를 최소화하는 방향으로 파라미터를 업데이트한다.

α가 양수값이라면 θ(=w)가 반복적으로 갱신되면서 최솟값에 도달하게 될 것이다.

θ의 갱신은 기울기 하강과 기울기 상승 두가지로 나뉜다.

1. 대칭축을 기준으로 오른쪽 영역의 한 지점을 초기값으로 설정한 경우

- 오른쪽 영역의 기울기(미분값)는 양수

- 갱신 시 θ는 감소하여 최솟값 지점으로 이동

2. 대칭축을 기준으로 왼쪽 영역의 한 지점을 초기값으로 설정한 경우

- 오른쪽 영역의 기울기(미분값)는 음수

- 갱신 시 θ는 증가하여 최솟값 지점으로 이동

이러한 이유로 경사 하강 알고리즘에서는 초기값을 어디로 설정하든 결국은 최솟값으로 이동하게된다.

Learning Rate(학습 속도)

Learning Rate는 갱신 속도를 조정한다. Learning Rate가 작다면 갱신시 아주 조금 이동하고 크다면 아주 많이 이동한다.

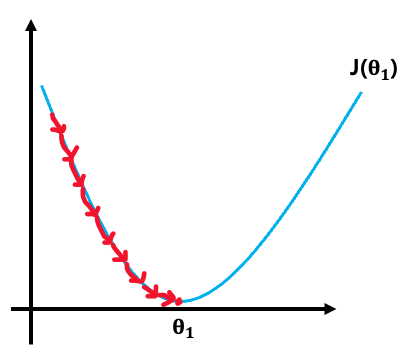

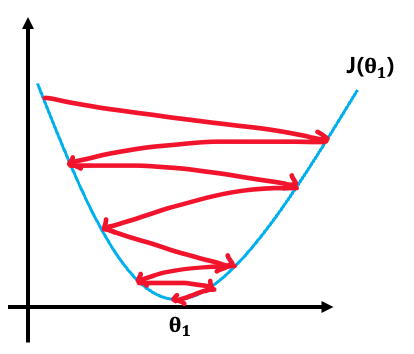

그림을 통해 자세히 알아보자.

Learning Rate가 지나치게 작을 경우 최솟값에 도달하기 위해 많은 연산이 요구된다.

Learning Rate가 지나치게 크다면 최솟값에 도달하기 위해 반대편을 오가며 매우 큰 거리를 이동하며 최솟값에서 점점 멀어진다.

이 두가지 경우가 있기 때문에 적절한 Learning Rate를 설정하는 것은 매우 중요하다.

w(= θ)의 수렴 조건

경사 하강 알고리즘이 멈추는 조건(수렴 조건)에 대해 알아보자.

극점에서 함수는 기울기가 0이므로 w가 최솟값에 도달했다면 해당 지점에서 미분값이 0일 것이고 이 경우 바로 직전의 값과 갱신값 사이의 변화가 없을 것이다. 이때가 Cost Function이 최소가 되는 경우이기 때문에 경사 하강 알고리즘이 갱신을 멈추게된다.

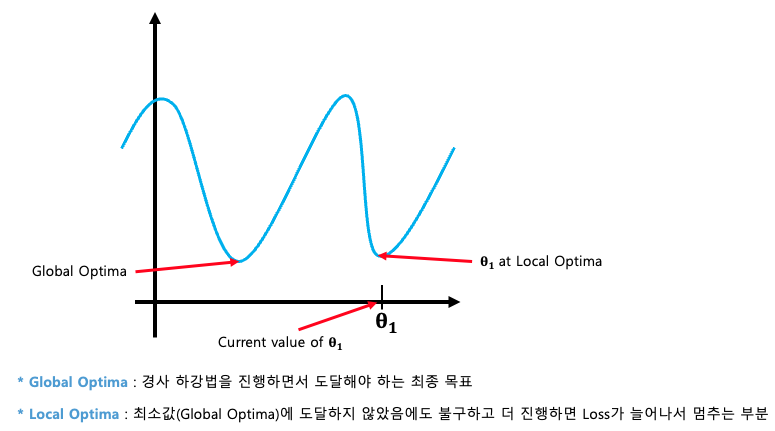

Local Optima

경사 하강 알고리즘은 Cost Function이 최소가되는 경우 갱신을 멈춘다. 하지만 이 멈추는 곳이 반드시 우리가 찾는 Global Optima가 아닐 수 있다.

그 경우는 Local Optima에 도달했을 경우인데 이 경우는 최소값이 더 존재하지만 갱신을 더 진행할 경우 Loss가 늘어나기 때문에 알고리즘이 갱신을 멈추는 경우이다.

Local Optima에 빠지는 경우는 Optimization을 잘못한 경우이다. 경사 하강의 초기 지점 부터 Global Optima로 이동하는 도중에 Local Optima에 도달하기 때문이다.

하지만 요즘 trend에 의하면 실제 딥러닝에서 Local Optima에 빠질 확률이 거의 없기 때문에 Local Optima 해결을 위해 Optimization을 할 이유가 없다고 한다.

- 비선형성 : 가중치 공간에서 많은 Local Optima를 가질 수 있으나, Cost Function은 대부분 복잡하고 다차원적인 구조를 가지기 때문에 실제로 Local Optima에 빠지는 경우는 드물다.

- 초기화와 다양한 해 탐색 : 딥러닝 모델의 가중치는 초기에 무작위로 초기화되고 이 가중치는 다양한 해 공간을 탐색하며 경사 하강 알고리즘이 Local Optima에 빠지는 가능성을 줄인다.

- 한줄 요약 : w가 매우 많음(cost function의 차원이 큼), 모든 차원에 대해 w를 미분했을 경우 양수여야 함(모든 w가 local optima에 빠짐), 이 가능성은 매우 희박함.

Plateau 문제

학습 과정에서 Cost Function이 더 감소하지 않고 일정한 수준에서 정체되는 현상을 말한다.

(즉, 가중치를 업데이트해도 Cost Function의 값이 거의 변하지 않는 상태)

이 문제는 Local Optima와 다르게 고민해봐야 할 문제이다.

발생하는 상황은 다음과 같다.

- Local Optima: 경사 하강법은 local optima에 빠질 수 있으며, 이 경우 비용 함수가 더 이상 감소하지 않고 정체될 수 있다. 지역 최적해에 갇힌 경우 global optimum로 수렴하지 못하고 플라토 상태에 빠질 수 있다.

- 학습률: 경사 하강법에서 학습률(learning rate)은 가중치 업데이트의 크기를 결정하는 요소이다. 학습률이 너무 작으면 업데이트가 너무 느리게 이루어지고, 학습률이 너무 크면 발산할 수 있습니다. 적절한 학습률을 선택하지 못하면 플라토 문제가 발생할 수 있다.

- 볼록하지 않은 비용 함수: 비선형하거나 다차원적인 비용 함수는 볼록하지 않을 수 있다. 이러한 비용 함수에서는 경사 하강법이 볼록한 영역에 갇힐 수 있으며, 플라토 상태에 빠질 수 있다.

이 문제를 해결하기 위해서는 Learning Rate를 조정하거나 다른 최적화 알고리즘을 사용하거나 초기화를 다르게 설정하여 극복할 수 있다.

또, 가중치 조기화, 배치 정규화, 학습률 스케줄링 기법을 사용하여 학습 과정을 안정화 시킬 수 있다.

Gradient Descent.ipynb

Colaboratory notebook

colab.research.google.com

'AI > Coursera' 카테고리의 다른 글

| [Coursera] 6. Opitmization (0) | 2023.12.31 |

|---|---|

| [Coursera] 5. Optimization Problem (0) | 2023.12.28 |

| [Coursera] 4. Practical Aspects of Deep Learning (0) | 2023.12.27 |

| [Coursera] 2. Logistic Regression (0) | 2023.12.17 |

| [Coursera] 1. Neural Network (0) | 2023.08.28 |